8 Minuty

Google představil Gemini 2.5 Computer Use — nový model umělé inteligence, který napodobuje, jak člověk pracuje s webovými stránkami a webovými aplikacemi. Nyní je v veřejné ukázce přes Gemini API v Google AI Studio a Vertex AI. Model je navržen k automatizaci reálných úloh v prohlížeči s nižší latencí a lepší vizuální dedukcí.

Co vlastně model umí a proč na tom záleží

Gemini 2.5 Computer Use rozšiřuje vizuální porozumění modelu Gemini 2.5 Pro tak, aby prováděl „praktické“ akce v prohlížeči: klikání, psaní, rolování, najetí myší, otevírání rozbalovacích nabídek a navigaci na URL. Místo volání webových API agent analyzuje snímky obrazovky a vrací přesné UI akce, které mají být provedeny — v podstatě učí AI používat web stejně, jako by ho používal člověk.

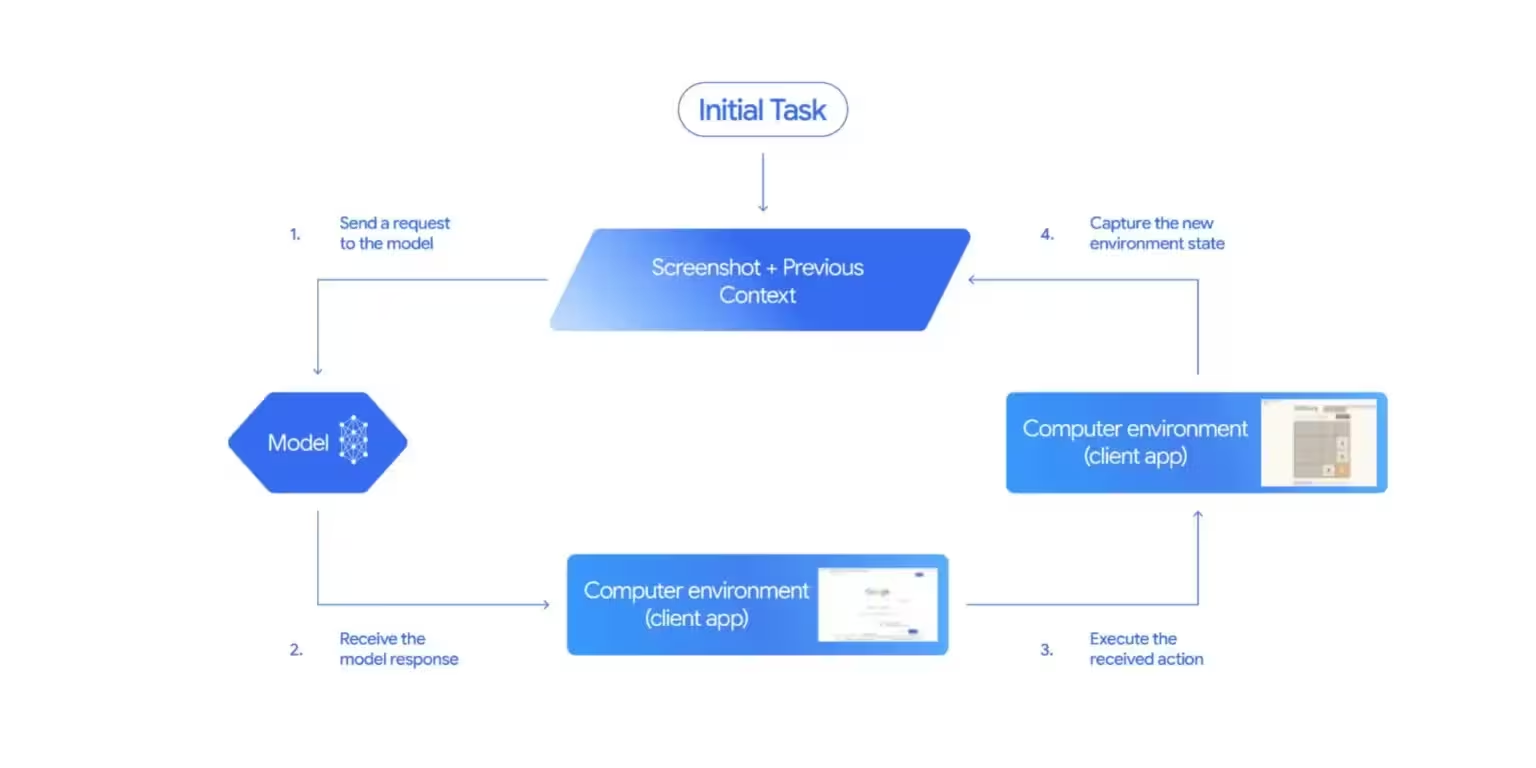

Jak to funguje: snímky, smyčky akcí a klientské provedení

Model přijímá tři vstupy: zadání úkolu, snímek aktuálního uživatelského rozhraní a krátkou historii posledních akcí. Na základě těchto dat vyhodnotí vizuální rozložení stránky a navrhne jednu konkrétní UI akci (např. klikni na toto tlačítko nebo vlož text do tohoto pole). Tato akce se provede na klientovi a nový snímek obrazovky se odešle zpět modelu. Smyčka pokračuje, dokud není úloha dokončena.

Představte si jednoduchý, ale kritický scénář: migrace záznamů pacienta z veřejné stránky do interního CRM. Namísto psaní skriptů pro každou konkrétní strukturu HTML agent rozpozná vizuální prvky — seznam, tlačítka, formuláře — a provede posloupnost kliknutí a zadání textu, která přenese data bezpečně a konzistentně. To mění způsob, jakým se dá automatizovat práce v prohlížeči, protože se méně spoléháte na stabilní API a více na schopnost „vidět“ a reagovat na UI.

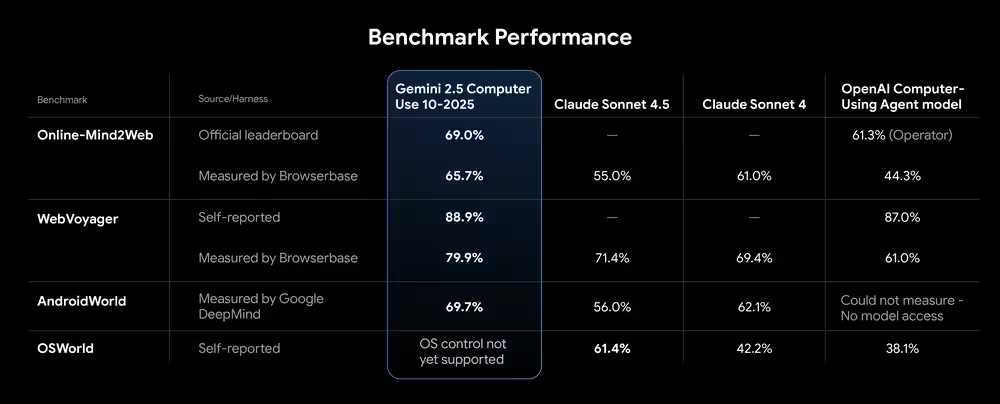

Ukázky, benchmarky a co nám dávají demo videa

Google uvádí, že Gemini 2.5 Computer Use překonává jiné nástroje v benchmarkech jako Online-Mind2Web, WebVoyager a AndroidWorld, přitom udržuje nízkou latenci. Demo klipy, často zrychlené, ukazují toky práce jako přesun lepicích poznámek na digitální nástěnce nebo přenos zvířecích záznamů z webu do CRM. Tyto ukázky názorně ilustrují, jak agent dokáže spojit jednoduché UI kroky do komplikovanějšího workflow.

Co ukazují videa dobře: schopnost řetězit více drobných akcí, rozpoznat změny ve vizuálném stavu a pokračovat bez manuálního zásahu. To má přímý dopad na produktivitu — méně ručního testování, méně fallback kódu pro specifické HTML zustavby a rychlejší prototypování automatizovaných asistentů.

Schopnosti, omezení a kam se model hodí

Model aktuálně podporuje 13 odlišných UI akcí a nejlépe funguje v prostředí webového prohlížeče. Google upozorňuje, že není zcela optimalizovaný pro automatizaci na úrovni desktopových operačních systémů, i když předběžné mobilní benchmarky vypadají slibně. Interní týmy jej již používají k UI testování a automatizaci v službách jako Search nebo Firebase.

Co zvládá dobře

- Vizuální rozpoznávání elementů bez přístupu k HTML DOM.

- Řetězení jednoduchých akcí do komplexního workflow.

- Rychlá opakovaná interakce s uživatelským rozhraním s nízkou latencí.

Limitace a rizika

I přes pokroky existují omezení. Model může být zranitelný vůči velmi dynamickým nebo netypickým rozhraním, které často mění vizuální strukturu. Také není primárně určen k plnohodnotné automatizaci operačního systému jako takového — jeho doména zůstává uvnitř prohlížeče. Dále se objevují otázky spolehlivosti v prostředích s omezeným přístupem k síti nebo s nízkým rozlišením obrazovky.

Bezpečnostní design a kontrola pro vývojáře

Bezpečnost je klíčová. Každá navrhovaná akce je před provedením ověřena bezpečnostní službou. Vývojáři si mohou vypnout konkrétní akce nebo vyžadovat explicitní potvrzení uživatele u citlivých kroků — například u finančních transakcí nebo operací s vysokým rizikem. To umožňuje integrovat model do reálných aplikací bez obětování zásadních bezpečnostních kontrol.

Pro vývojáře jsou k dispozici ovládací mechanismy, které dávají možnost nastavit sandboxová pravidla, omezit typy akcí a logovat auditní stopy. V praxi to znamená, že při automatizaci interních workflow můžete snadno vyžadovat dodatečná potvrzení pro změny, které mají právní nebo finanční důsledky.

Jak ho dnes vyzkoušet

- Přístup přes Gemini API v Google AI Studio nebo Vertex AI.

- Vyzkoušejte demo prostředí Browserbase, které Google poskytuje pro testování.

- Přihlaste se do programů early access pro budování asistentů nebo automatizačních nástrojů založených na on-screen reasoning.

Kroky pro rychlý start

Chcete-li začít, připravte si testovací prohlížeč v izolovaném prostředí a definujte několik scénářů — vyplnění formuláře, přenos seznamu položek, či reorganizace dashboardu. Následně integrujte volání do Gemini API, pošlete úlohu s počátečním snímkem a sledujte, jak agent navrhuje akce. Během testování si všimnete, jak důležité je správné nastavení bezpečnostních filtrů a validace výsledků po každém kroku.

Praktické použití v týmech a na trzích

Kdo by měl model sledovat? Produktové týmy vytvářející asistenty v prohlížeči, QA inženýři, kteří potřebují chytřejší UI testy, a vývojáři automatizující opakované webové workflow naleznou v Gemini 2.5 Computer Use praktického partnera. Pokud vaše aplikace vyžaduje lidsky podobnou interakci s komplikovanými webovými rozhraními, stojí za to tento model prozkoumat.

Ve firemním prostředí je potenciál nasazení široký: od automatizovaného onboarding procesů přes migraci dat mezi legacy webovými nástroji až po inteligentní asistenty, kteří uživateli „pomůžou“ s úkoly v rozhraních, která nemají dobře dokumentované API. Pro start-upy to může znamenat rychlé prototypování užitečných funkcí bez velké investice do specifického integračního vývoje.

Technické detaily pro integrátory

Při integraci s Gemini 2.5 Computer Use je dobré znát několik technických bodů. Model pracuje s obrazovkovými snímky ve standardních formátech (PNG, JPEG, webp/avif) a vrací strukturované instrukce reprezentující UI akce. Tyto instrukce obsahují typ akce, cílové souřadnice nebo identifikátory elementů ve vizuálním rozložení a volitelné parametry jako text ke vložení nebo časová prodleva mezi kroky.

Architektura podporuje asynchronní smyčku: klient vykoná jednu akci, pošle nový snímek a model navrhne další krok. Tento přístup minimalizuje konflikt mezi paralelními interakcemi a usnadňuje auditování kroků. Důležité je také spravovat limity volání a latenci — nasazení v produkci by mělo mít fallback logiku pro případ, že model není dostupný nebo že navržená akce selže.

Tipy pro robustní nasazení

- Implementujte retry logiku a validace výsledků po každé akci.

- Vytvořte monitorovací panely pro sledování chybovosti a latence.

- Oddělte citlivé operace do samostatných workflow s přídavnými kontrolami uživatele.

Budoucnost: kam se to může vyvinout

Gemini 2.5 Computer Use je krok směrem k AI, která skutečně rozumí vizuálnímu kontextu a dokáže s ním bezpečně pracovat. Další směry vývoje mohou zahrnovat lepší adaptaci na mobilní prostředí, hloubkovou integraci s OS-level událostmi a vylepšené rozpoznávání kontextu napříč vícero okny a záložkami. Můžeme rovněž očekávat lepší nástroje pro ladění a vysvětlování rozhodnutí modelu, což je klíčové pro přijetí ve firemním prostředí.

Vývojáři a produktoví manažeři by měli s těmito technologiemi experimentovat v kontrolovaných podmínkách: testovat edge-cases, sledovat bezpečnostní skóre a sbírat uživatelskou zpětnou vazbu. Právě kombinace vizuálního rozpoznání, nízké latence a bezpečnostních kontrol může znamenat, že do několika let se automatizace uživatelských rozhraní stane standardní součástí vývojářských sad a produktových strategií.

Gemini 2.5 Computer Use tedy nabízí nejen nástroj, ale i nový způsob, jak přemýšlet o automatizaci: méně kódu závislého na konkrétních DOM strukturách, více inteligence schopné reagovat na změny v uživatelském rozhraní podobně jako člověk. To je hlavní důvod, proč si tento krok od Google zaslouží pozornost — a proč by jej měli vyzkoušet ti, kteří stavějí budoucnost interaktivních webových aplikací.

Zdroj: gizmochina

Zanechte komentář