7 Minuty

Nová rodina TPU od Googlu s kódovým označením Ironwood znovu rozvířila již tlející souboj v oblasti hardwaru pro umělou inteligenci: tentokrát skutečným rivalem Nvidie nejsou ani AMD ani Intel, ale vlastní zakázkové křemíkové řešení Googlu optimalizované pro inference. Díky ohromné kapacitě paměti, hustým propojením mezi čipy a ambiciózním tvrzením o energetické účinnosti Ironwood předefinuje podobu cloudové AI v měřítku hyperscalerů a velkých provozovatelů. Tento krok zdůrazňuje, že infrastruktura určená primárně pro inferenční provoz — nízká latence, vysoká propustnost dotazů a nízké náklady na dotaz — je novým středobodem konkurenčního boje o trh s cloudovými službami a inferenční infrastrukturou.

Ironwood čísly: paměť, výpočet a škálovatelný SuperPod

V jádru je Ironwood (TPU v7) navržen pro jednu věc — provozovat modely v produkčním prostředí. Google jej prezentuje jako inferenčně orientovaný čip s parametry, které cílí na snížení latence, minimalizaci energie na dotaz a zjednodušení nasazení velkých jazykových modelů a dalších realtime AI služeb. To znamená, že architektura klade důraz na on-package paměť, nízkou komunikaci mezi čipy a konzistentní latenci pod tíhou velmi velkých modelů. Pro operátory cloudů a firmy provozující kontinuální inference je takový návrh primárně o efektivitě — nejen o peak TFLOPs, ale o tom, kolik dotazů dokáže systém obsloužit za jednotku času, jaká je průměrná doba odezvy a kolik stojí provoz za měsíc či rok.

- Peak FP8 compute per chip: ~4,614 TFLOPs

- On-package memory: 192 GB HBM3e (roughly 7–7.4 TB/s bandwidth)

- Pod scale: up to 9,216 chips per SuperPod

- Aggregate compute per pod: ≈42.5 exaFLOPS (FP8)

- System HBM per pod: ~1.77 PB

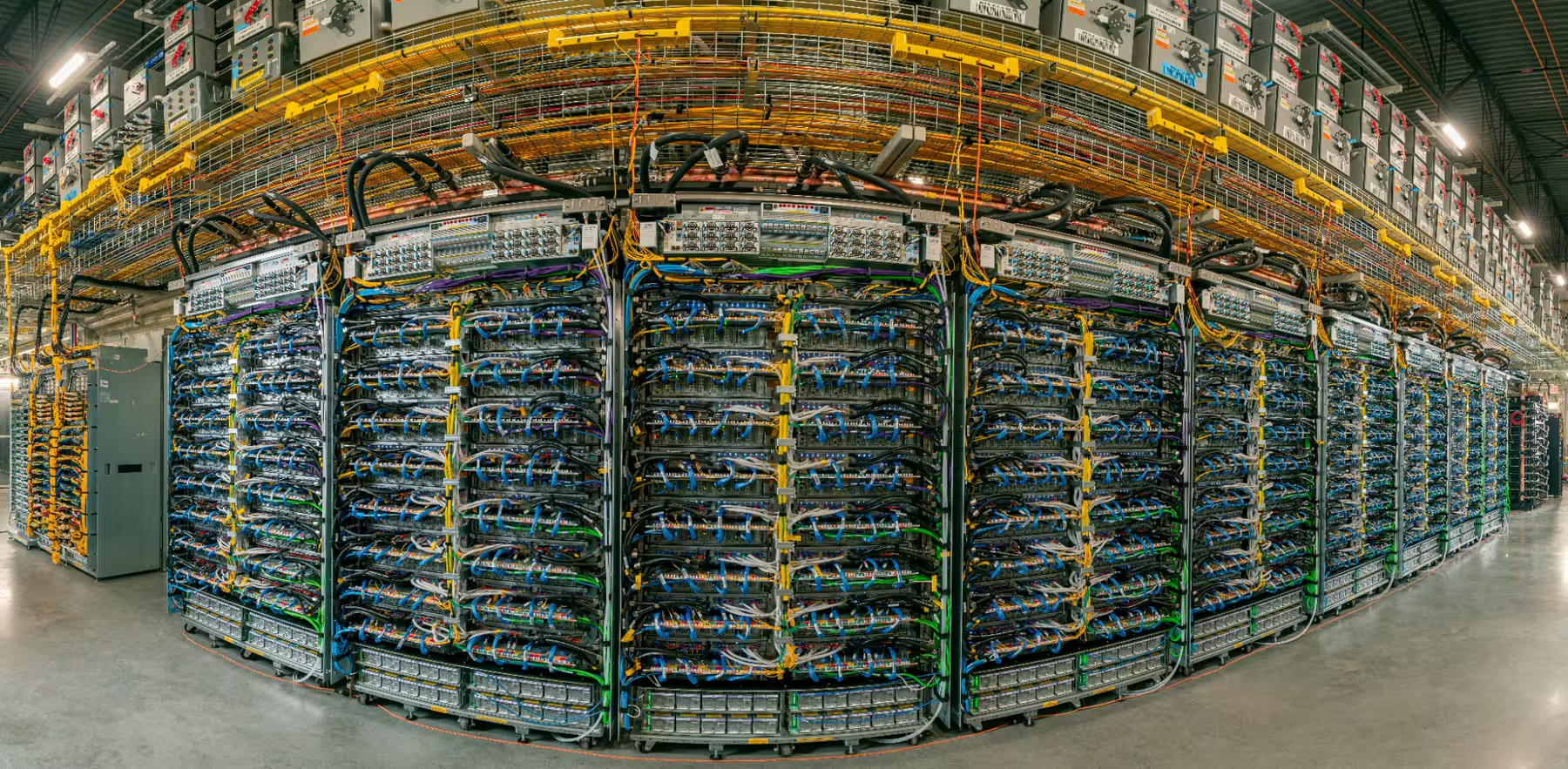

Tyto surové parametry jsou důležité, ale rozhodující je také způsob, jakým si čipy vzájemně vyměňují data. Google používá InterChip Interconnect (ICI) a 3D toroidní (3D torus) uspořádání, které propojí velké množství čipů do koherentního SuperPodu. Tato topologie a tzv. scale-up fabric, doplněná o inter-pod síť s kapacitou přibližně 1.8 PB, umožňuje udržet velké modely přímo v rychlé HBM paměti bez opakovaného přeposílání vah přes pomalejší rozhraní. V praxi to znamená méně latence způsobené přesuny dat, vyšší stabilitu odezvy a lepší škálovatelnost pro inferenční nasazení, kde zátěž tvoří miliardy samostatných dotazů denně.

Proč inferenční provoz mění mapu konkurence

Dříve se pole bitev soustředilo na trénink: surové TFLOPs, obrovské pooly paměti a vysoce optimalizované jádra určovaly vítěze — a v tom dominovaly GPU od Nvidie. Ekonomika AI se však posouvá. Poté, co je model natrénován, skutečná zátěž tvoří miliardy inferenčních dotazů — nikoli tréninkové běhy. To mění priority: nejdůležitější jsou nyní latence, propustnost dotazů, energetická náročnost na jeden dotaz a celková nákladová efektivita provozu. Pro obchodní modely založené na reálném čase a velkém počtu uživatelských požadavků (chatboty, API pro generativní AI, realtime doporučení) se klíčovým parametrem stává cena a odezva na 1 000 nebo 1 000 000 dotazů, nikoli jen peak FP32 nebo FP64 FLOPs.

.avif)

Ironwood je koncipovaný přesně kolem těchto metrik. Velká on-package paměť omezuje režii spojenou s komunikací mezi čipy u obřích modelů, což výrazně snižuje latenci a stabilizuje odezvu při škálování. Google uvádí, že Ironwood přináší významné generační zlepšení v oblasti výkonu a energetické účinnosti — firma mluví o přibližně 2× zlepšení účinnosti oproti předchozím generacím TPU. Pro hyperscalery, provozovatele cloudů a velké korporátní zákazníky, kteří platí za nepřetržité inferenční kapacity, může takové zlepšení znamenat řádové snížení provozních nákladů, lepší SLA a konkurenceschopnější cenu za škálovatelnou inferenční infrastrukturu.

Interkonekty, SuperPody a riziko vendor lock-in

Další konkurenční výhodou je vertikální integrace. Díky tomu, že Google nasazuje Ironwood přes Google Cloud, může firma optimalizovat celý zásobník — hardware, síťové vrstvy a runtime — aby snížila náklady na dotaz. Architektura SuperPodu s hustou mezichipovou konektivitou a scale-up fabric je navržena tak, aby obsloužila velmi velké modely s menšími výkonovými penalizacemi než rozdělena a heterogenní GPU farma. To umožní provozovat modely „in-memory“ a minimalizovat latenci způsobenou přesuny vah mezi uzly.

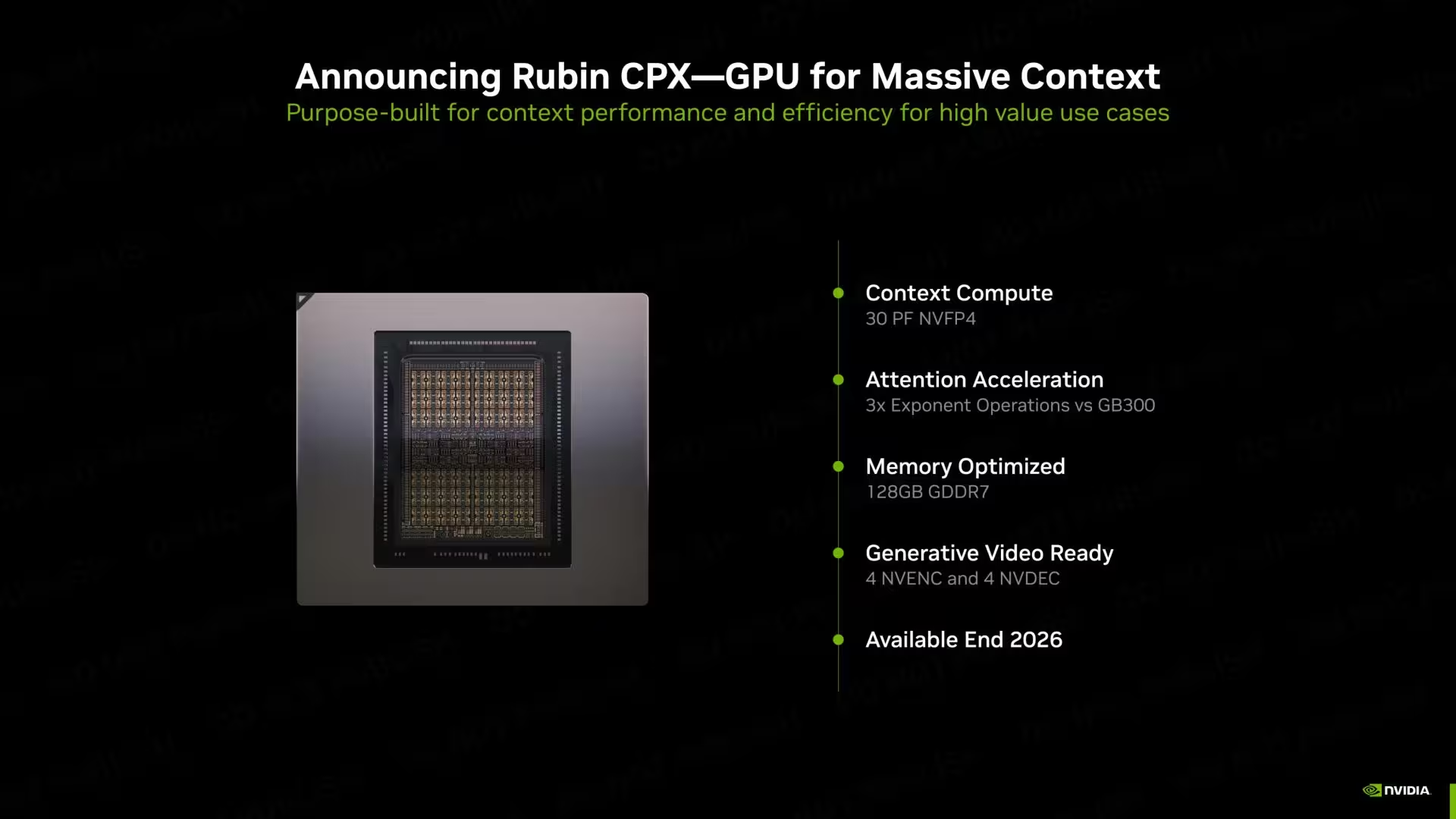

Tato vertikální integrace zároveň zvyšuje strategické riziko pro konkurenci, zejména pro Nvidii. I přes to, že Nvidia vyvíjí řešení zaměřená na inference — jako jsou Rubín racky a B200 Blackwell GPU — mohou si zákazníci v cloudu raději zvolit nativní TPU infrastrukturu, pokud ta reálně snižuje latenci a provozní náklady. Důsledkem může být silnější vendor lock-in k platformě, která nabízí lepší cenu za dotaz a jednodušší správu škálovatelného inferenčního provozu. To ovlivňuje rozhodování velkých zákazníků a hyperscalerů, kteří musí promyslet nejen výkon, ale také dlouhodobé náklady, interoperabilitu a flexibilitu mezi cloudy.

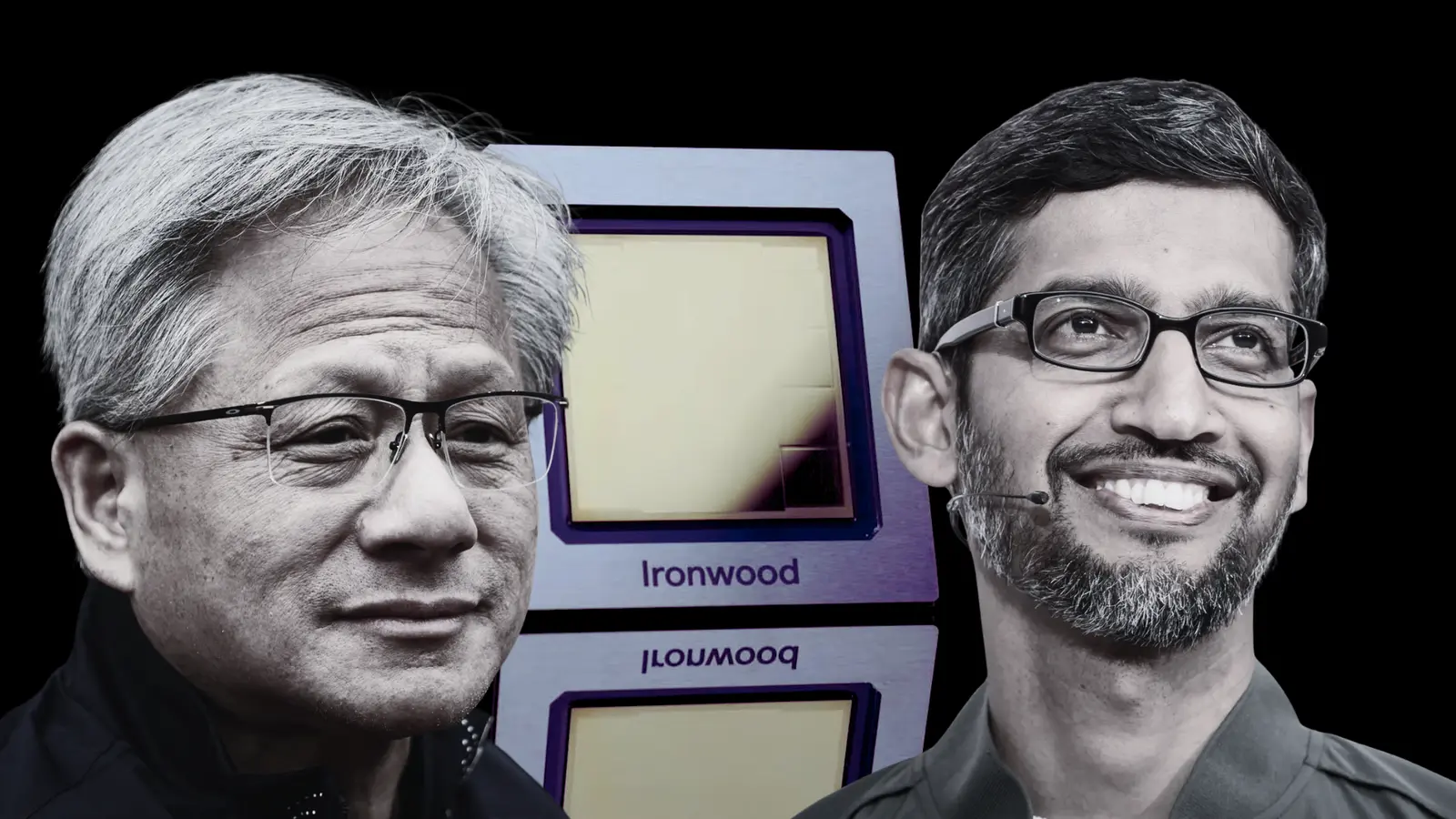

Jensen Huang si toho všiml

Generální ředitel Nvidie veřejně uznal, že vývoj vlastních ASIC je náročný a označil TPUs za významného konkurenta. Taková přiznání nejsou bezvýznamná: když dominantní hráč otevřeně identifikuje rivalitu s jinou technologií, obvykle to signalizuje intenzivnější investice a zrychlené produktové cykly na obou stranách. To může vést k rychlejším iteracím, agresivnějšímu ladění softwarové a síťové vrstvy a širšímu testování nasazení u klíčových zákazníků. Pro zákazníky to znamená více možností, pro dodavatele pak tlak na snižování nákladů a zlepšování interoperability mezi GPU a inferenčními ASIC řešeními.

Je Nvidia na odpis?

V žádném případě — pravidla se však mění. Nvidia stále vede v oblasti univerzální GPU výpočetní kapacity, rozsáhlého softwarového ekosystému (CUDA, TensorRT a dalších nástrojů) a širokého přijetí v oblasti tréninku a v mnoha inferenčních scénářích. Co Ironwood mění, je otevření nové osy konkurence zaměřené na ekonomiku inference. Pro firmy provozující masivní realtime nasazení může být TPU strategie Googlu rozhodujícím faktorem při volbě platformy: jde o kompromis mezi flexibilitou GPU, dostupností ekosystému a cenou za dotaz/latencí, kterou mohou získat s nativní TPU infrastrukturou.

Firmy tak budou muset zvažovat několik faktorů: typy modelů (velikost parametru a paměťové nároky), požadované SLA (latence a propustnost), náklady na energii a provoz, náklady na přesun modelů mezi cloudy a kompatibilitu nástrojů pro nasazení. To otevírá prostor pro hybridní přístupy — kombinaci GPU pro trénink a TPU pro produkční inference — nebo pro volbu jediného poskytovatele, pokud nabízí výrazné provozní výhody. V každém případě posun směrem k inferenčně orientovaným architekturám zvýrazňuje nové metriky úspěchu: cena na dotaz, stabilní nízká latence a snadná správa škálovatelných SuperPodů.

Stručně řečeno: soutěž v oblasti AI se vyvíjí z „kdo má nejvíc flops“ na „kdo obslouží nejvíce dotazů nejlevněji a nejs rychleji“. S tím, jak Ironwood vstupuje do produkce, lze očekávat, že poskytovatelé cloudu, hyperscale společnosti a velké podniky přehodnotí, kde budou provozovat inferenční zátěže — a to činí z Googlu nyní nejzajímavějšího soupeře, kterého stojí za to sledovat. Pro provozovatele AI služeb to znamená silnější zaměření na optimalizaci inferenčního stacku, důkladné testování latence a energetické účinnosti a pečlivé porovnávání TCO mezi GPU a TPU řešeními ve výrobním provozu.

Zdroj: wccftech

Zanechte komentář