8 Minuty

Krátké varování uprostřed noci: co se právě děje

Představte si, že uprostřed noci přijde rodiči SMS nebo oznámení: „Váš dospívající vyhledával obsah o sebepoškozování.“ Krátké. Otřesné. Nevyhnutelné.

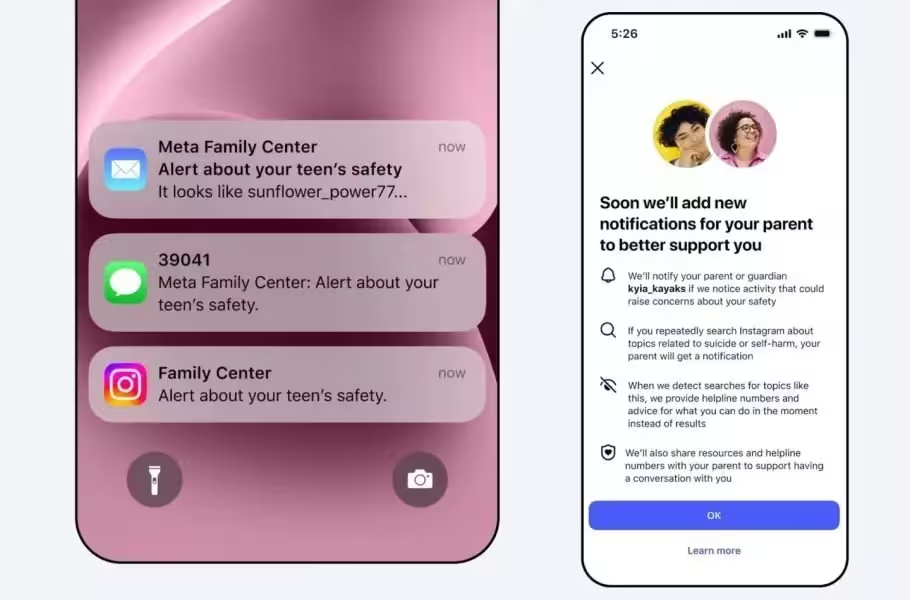

Společnost Meta uvádí, že právě o to jde. Firma začne upozorňovat rodiče, když účty dospívajících opakovaně vyhledávají výrazy spojené se sebevraždou nebo sebepoškozováním v krátkém časovém úseku. Funkce má být nasazena příští týden pro teen účty v Spojených státech, Spojeném království, Austrálii a Kanadě, přičemž širší globální rozšíření je plánováno do konce roku.

Existují ovšem podmínky. Tento systém funguje pouze v domácnostech, které už aktivovaly nástroje rodičovského dohledu Instagramu. Tato funkce vyžaduje, aby byly tyto kontroly zapnuté dříve, než mohou upozornění dorazit k pečujícím osobám. Instagram již blokuje některé škodlivé výsledky hledání a nasměruje uživatele k podpůrným zdrojům, ale jedná se o první případ, kdy platforma proaktivně předává informace rodičům na základě vyhledávacího chování mladého člověka.

Jak budou rodiče kontaktováni a co oznámení obsahuje

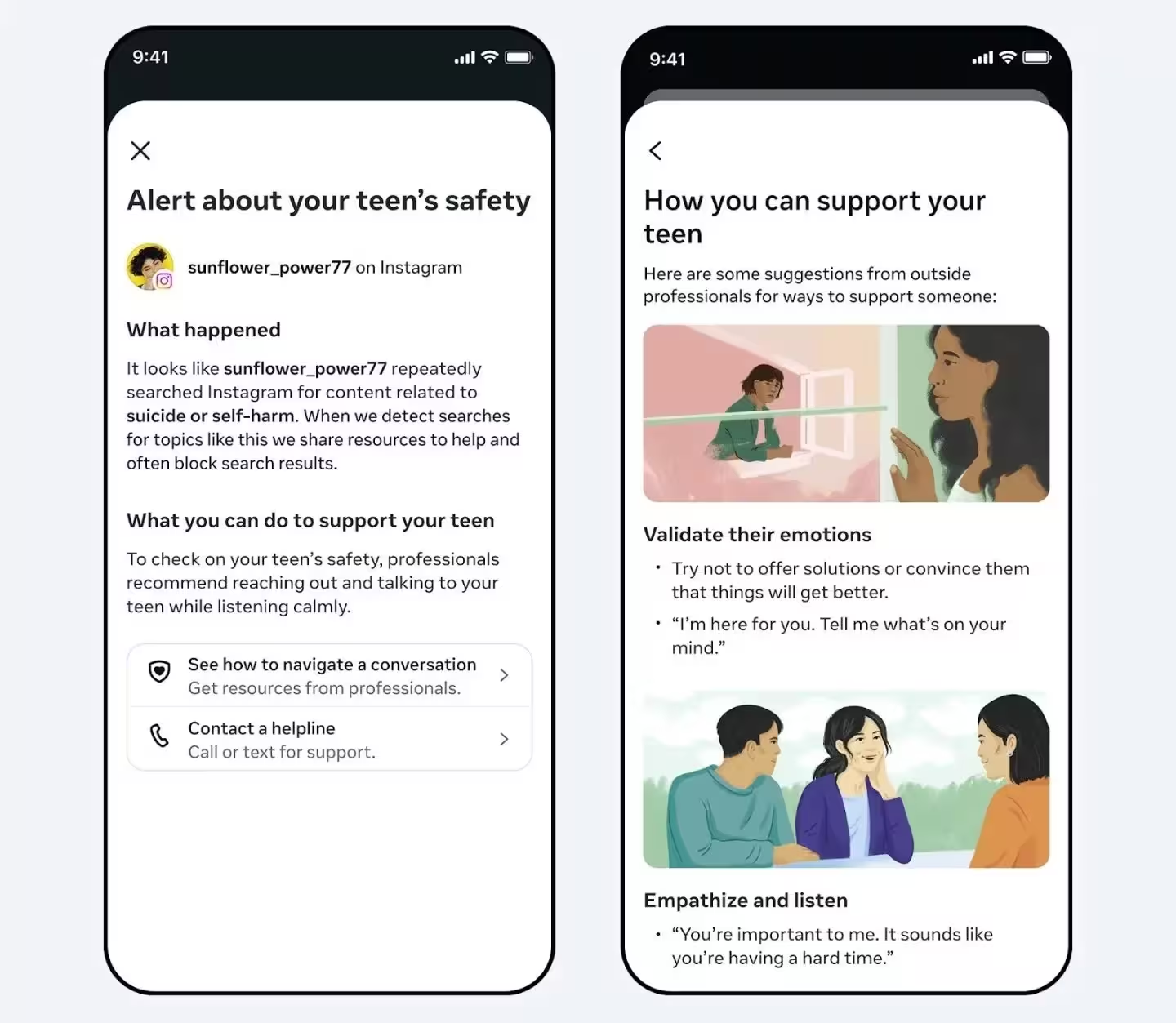

Jak budou rodiče kontaktováni? Meta uvádí, že použije kontaktní metodu navázanou na účet dohlížející osoby — textové zprávy, e‑mail, WhatsApp nebo oznámení v aplikaci — podle toho, jaké informace jsou k dispozici. Každé upozornění bude doprovázeno radami a vzdělávacími zdroji zaměřenými na to, jak v rodině zahájit obtížné rozhovory a kde v případě potřeby hledat odbornou pomoc. Meta popisuje systém jako úmyslně opatrný; může označovat podezřelé vzorce i v situacích, kdy není nebezpečí stoprocentně jisté — dává přednost bezpečí před mlčením.

Co přesně se mění v praxi

Do teď: některé vyhledávací dotazy u dospívajících přesměrovávaly uživatele na obrazovky s podporou a zdroji pomoci. Nově: tato přesměrování budou zároveň generovat signály, které mohou spustit rodičovské upozornění, pokud detekované chování naznačuje opakovaný zájem nebo možné riziko.

Pro teenagery to znamená, že vyhledávání, která dříve jen viděla podpůrné informace, mohou nyní signalizovat rodinám, že nastává problém. Pro rodiče může být taková zpráva prvním náznakem něčeho skrytého. Pro odborníky a advokáty jde o připomínku, že detekce není náhradou za prevenci — a že platformy musí nést odpovědnost za dopady svého doporučovacího systému na zranitelné uživatele.

Omezení systému a praktické námitky

Ne všichni jsou uklidněni. Andy Burrows, ředitel nadace Molly Rose Foundation, varuje, že náhlá oznámení mohou vyděsit pečovatele, kteří nejsou připraveni řešit krizi, a že tento krok hrozí přesunutím odpovědnosti z platformy na rodiny. Nadace, která vznikla po sebevraždě 14leté Molly Russell v roce 2017, tvrdí, že Instagram stále doporučuje obsah související s depresí a sebepoškozováním mladým lidem, a věří, že opravdovým řešením by bylo napravit algoritmické zesílení škodlivého obsahu, ne přenášet problém na rodinnou péči.

Technické detaily a jak systém pravděpodobně funguje

Meta nezveřejnila kompletní technický popis algoritmů, které určují, kdy se upozornění odešle. Nicméně na základě běžných praktik detekce rizik lze odhadnout následující komponenty:

- Klíčová slova a fráze: soubor termínů spojených se sebevraždou, sebepoškozováním nebo intenzivní depresí, které jsou považovány za signály rizikového chování.

- Sledování vzorců: opakované nebo eskalující vyhledávání během krátké doby slouží jako zvýšený ukazatel záměru.

- Prahové hodnoty: systém pravděpodobně používá kombinaci četnosti a kontextu (např. doplňující dotazy), aby snížil množství falešných poplachů.

- Filtrace kontextu: snaha rozlišit mezi akademickým, novinářským či „zvědavým“ hledáním a hledáním s potenciálním sebeškodlivým záměrem.

- Ochrana soukromí: data spojená s vyhledáváním by měla zůstat v rámci platformy a sdílení s rodiči povolit pouze agregované a nezbytné informace — podle deklarovaných zásad Meta.

Tato architektura ilustruje kompromis mezi včasným zásahu a ochranou soukromí uživatelů. V praxi se ale objevují otázky: Jak přesné jsou filtry? Kdo nastavuje prahové hodnoty? A jak se naloží s falešnými pozitivy?

Etické a právní implikace

Z etického hlediska je systém kontroverzní. Zatímco cílem je snížit riziko, přístup založený na monitorování vyhledávání mladých lidí zasahuje do prostorů, které tradičně považujeme za soukromé. Z právního hlediska se situace liší země od země — v některých jurisdikcích mohou existovat omezení týkající se sdílení zdraví souvisejících informací nebo zásahů do soukromí nezletilých uživatelů.

Regulační nástroje v Evropě, USA i dalších regionech se stále snaží vyrovnat s rychlým vývojem digitálních služeb. Tento krok Meta by mohl spustit nová pravidla ohledně transparentnosti algoritmů, povinností platforem při ochraně duševního zdraví a standardů pro implementaci rodičovského dohledu v aplikacích sociálních sítí.

Reakce odborníků a advokátů

Odborníci na duševní zdraví obvykle vítají iniciativy, které mohou předejít krizím, ale varují před jednoduchými řešeními. Detekce založená na datech může identifikovat potenciálně ohrožené osoby, ale sama o sobě neřeší systémové faktory, které přispívají k riziku — jako je expozice škodlivému obsahu, kyberšikana nebo tlak sociálních sítí na image a přijetí.

Advokáti a obhájci práv dětí požadují větší transparentnost: jasné metriky úspěšnosti, mechanismy odvolání pro falešně označené uživatele a audit algoritmů třetí stranou. Také upozorňují, že samotné upozornění na rodiče bez adekvátní podpory pro rodinu a odbornou léčbu může být nedostatečné nebo dokonce škodlivé.

Praktická doporučení pro rodiče

Pokud jste rodič a plánujete aktivovat nebo už máte aktivovaný rodičovský dohled na Instagramu, zvažte následující kroky:

- Nastudujte si, jaká upozornění budete dostávat a jak jsou formulována — některé zprávy mohou být stručné, jiné podrobné.

- Připravte si kontakty na krizovou linku, psychiatra nebo psychologa, aby nebyl první impuls panika, ale konkrétní plán pomoci.

- Zahajte rozhovor s teenagerem dříve, než nastane krize — otevřený, nenásilný dialog o duševním zdraví snižuje stigma.

- Využijte doporučené zdroje a lokální služby uvedené v oznámení — často jsou součástí balíčku podpory, který Meta poskytuje.

- Zvažte kombinaci digitálních nástrojů s osobní podporou; technologie mohou doplnit, nikoli nahradit odbornou péči.

Jak mohou platformy zvýšit účinnost bez přenášení odpovědnosti

Platformy by měly usilovat o holistická řešení, která nezahrnují pouze upozornění rodinám, ale i vnitřní změny produktového designu a doporučovacích algoritmů. Konkrétní opatření mohou zahrnovat:

- Omezení nebo odstranění zesilování obsahu, který normalizuje nebo glorifikuje sebepoškozování a sebevraždu.

- Prioritizaci intervenčních a podpůrných zdrojů v doporučeních místo obsahu, který může riziko zvyšovat.

- Vnitřní audit a externí přezkum algoritmů za účasti odborníků na duševní zdraví, etiků a zástupců mladých uživatelů.

- Vyjasnění odpovědnosti: co platforma udělá, co očekává od rodiny, a jaké služby poskytuje nebo financuje.

Možné scénáře a dopady na ochranu dětí online

Tento krok Meta může vyvolat několik scénářů:

- Pozitivní scénář: včasné upozornění zachrání život nebo dovede rodinu k odborné péči — systém funguje jako jeden z prvních varovných mechanismů a platforma zároveň snižuje škodlivé doporučování obsahu.

- Paralelní scénář: systém zachytí některé rizikové případy, ale přitom vytvoří nové problémy — falešné poplachy, strach u rodin nebo zneužití oznámení v konfliktech.

- Negativní scénář: upozornění se stanou nástrojem pro odsun zodpovědnosti — platforma upozorní, ale neodstraní problematický obsah ani nezlepší doporučovací logiku; zátěž se přesune na rodiny a zdravotnický systém.

Regulátoři, samosprávy škol i nevládní organizace budou sledovat, který scénář převáží, a podle toho mohou navrhovat nové standardy pro digitální bezpečnost mladistvých.

Výzva k dalšímu výzkumu a transparentnosti

Aby byl tento typ opatření smysluplný, je potřeba systematický sběr dat o účinnosti: kolik upozornění skutečně vedlo k zásahu odborníků, jaký byl poměr falešných poplachů, a jaký dlouhodobý vliv mělo upozornění na rodinné vztahy a duševní zdraví dospívajících. Transparentní reporting a nezávislé hodnocení jsou klíčové pro pochopení rizik a přínosů.

Shrnutí a závěrečné úvahy

Toto opatření je dočasné řešení i reflektor zároveň. Upozornění může zachránit dítě v krizi, ale může také vyvolat širší debatu o tom, kdo nese odpovědnost za online škody — platformy, rodiny nebo regulátoři. Diskuse už probíhá a její výsledky formují budoucnost, jak budou platformy, rodiny a státní orgány přistupovat k duševnímu zdraví mladých lidí online.

Klíčová doporučení pro uživatele, rodiče a tvůrce politiky zahrnují kombinaci prevence, transparentnosti, odborné podpory a regulace algoritmů. Pouze tak lze zajistit, že technologie budou sloužit k ochraně zranitelných uživatelů, místo aby problém zjednodušovaly nebo přehazovaly na rodičovskou péči.

Nakonec: bezpečí dětí online je kolektivní odpovědnost. Technologie mohou být cenným nástrojem včasné identifikace, ale bez robustních systémů pomoci a odpovědného návrhu produktů zůstává riziko, že dopad bude omezený.

Zdroj: smarti

Zanechte komentář