5 Minuty

Požádáte-li AI chatbota o cenu akcie, datum soudu nebo jméno firemního vedoucího, odpověď může přijít s naprostou jistotou. To je znepokojivé. Věta může znít uhlazeně, tón může působit rozhodně, a přesto mohou být fakta špatně.

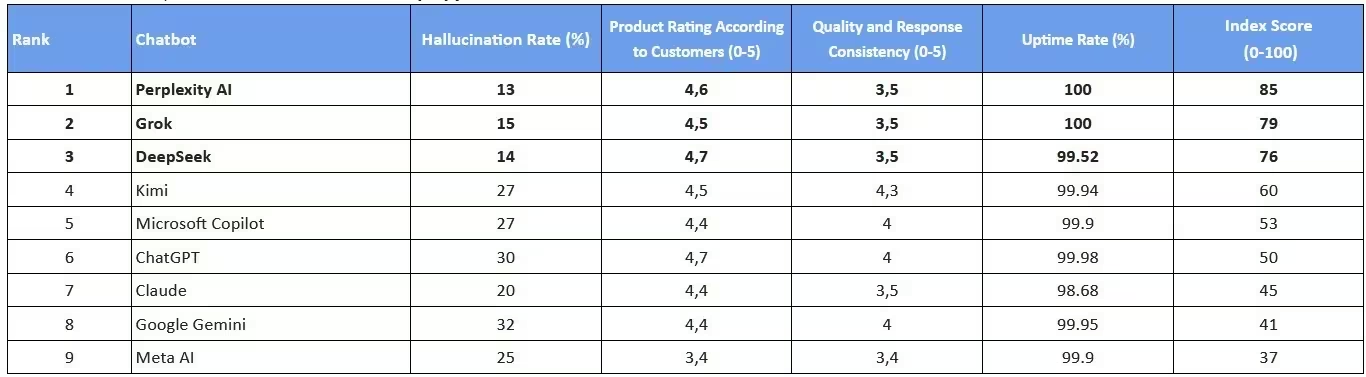

Nová analýza spolehlivosti od Legal Guardian Digital, SEO společnosti zaměřené na advokátní kanceláře, číselně ukazuje problém, který mnozí uživatelé již rozpoznali: někteří populární AI chatboti halucinují mnohem častěji než ostatní. S tím, že zhruba čtvrtina amerických pracovníků nyní pravidelně používá AI nástroje, rozdíl mezi užitečným asistentem a přesvědčivým zdrojem dezinformací není triviální.

Nepříjemná část: jistota není přesnost

Velké jazykové modely nemyslí jako lidé. Jsou trénované tak, aby předpovídaly pravděpodobná slova a fráze na základě vzorců v obrovském množství textu. Když má systém dost kontextu, může to vést k rychlým a užitečným odpovědím. Když ho nemá, model může přesto vygenerovat odpověď, která zní věrohodně, protože statisticky slova k sobě pasují.

To je to, co lidé obvykle myslí, když říkají, že AI chatbot halucinuje. Nejde o snění. Nejde o lhaní v lidském smyslu. Vytváří odpověď bez spolehlivého faktického základu, což je důvod, proč je nutné ověřovat jména, data, právní odkazy, lékařské podrobnosti, finanční údaje a zpravodajství člověkem.

Studie porovnala několik známých AI modelů tím, že sledovala míru halucinací, spokojenost zákazníků, kvalitu odpovědí a dostupnost služby. Tyto faktory byly kombinovány do indexového skóre od 0 do 100, čímž se získal širší pohled na to, které chatboty jsou v běžném použití nejspolehlivější.

Google Gemini vykázal nejvyšší míru halucinací ve skupině, údajně poskytoval nepřesné informace v 32 % odpovědí. Toto číslo je obzvlášť zajímavé vzhledem k zprávám, že Apple platí Google alespoň 1 miliardu dolarů ročně za použití vlastního Gemini modelu s 1,2 bilionu parametrů pro budoucí aktualizaci Siri očekávanou v iOS 27.

ChatGPT byl těsně za ním, s halucinacemi v přibližně třech z deseti odpovědí. Jednoduše řečeno, pokud by se čísla potvrdila, ChatGPT by v tomto testu poskytoval chybnou odpověď přibližně dvakrát častěji než DeepSeek. Toto srovnání pravděpodobně upoutá pozornost, nejen proto, že DeepSeek byl vyvinut za zlomek tréninkových nákladů spojených s předními americkými modely.

Perplexity AI dosáhla nejlepšího výsledku v míře halucinací, když falešné odpovědi dosahovaly uživatelů v 13 % případů. DeepSeek byla těsně za ní na 14 %, zatímco Grok od Elona Muska skončil na 15 %. Pro uživatele, kteří se spoléhají na AI pro výzkum, shrnutí nebo rychlé ověření faktů, mají tyto rozdíly význam.

Dostupnost online má stále význam

Přesnost je jen část příběhu. Chatbot může být na papíře vynikající a zároveň k ničemu, pokud není k dispozici, když jej někdo potřebuje. V oblasti dostupnosti byly Perplexity AI a Grok jedinými dvěma službami v průzkumu, které zůstaly během testovacího období dostupné po celou dobu.

ChatGPT a Gemini nebyly daleko, s dostupností 99,98 % a 99,95 % v uvedeném pořadí. Dokonce i Claude, který měl v této studii nejnižší dostupnost, zůstal velmi spolehlivý na úrovni 99,68 %. V praktickém smyslu byly většina těchto nástrojů online téměř pořád, ale drobné rozdíly mohou být důležité pro firmy, které se spoléhají na AI pracovní toky.

Spokojenost uživatelů vykreslila jiný obraz. DeepSeek a ChatGPT získaly nejvyšší skóre spokojenosti zákazníků 4,7 z 5. Perplexity AI následovala s 4,6. Meta AI se umístila na spodku s 3,4, zatímco několik dalších modelů se seskupilo kolem 4,4.

V konzistenci a kvalitě odpovědí vedla žebříček Kimi AI se skóre 4,3 z 5. ChatGPT, Microsoft Copilot a Gemini byly vyrovnané na 4,0. Meta AI opět skončila poslední na 3,4, což naznačuje, že její slabší celkové skóre nebylo způsobeno jedinou špatnou kategorií.

Když byly všechny faktory zkombinovány, Perplexity AI obsadila první místo s indexovým skóre 85. Grok byl druhý s 79, následoval DeepSeek. ChatGPT skončil šestý se skóre 50, zatímco Gemini skončilo osmý s 41. Meta AI byla na dně se 37.

Větší ponaučení není v tom, že bychom jednomu chatbotu měli slepě důvěřovat a jiného navždy vyřadit. AI nástroje se rychle mění. Modely se aktualizují, ochranná opatření se mění a výkon se může zlepšit prakticky přes noc. Přesto je takové pořadí užitečnou připomínkou: nejslavnější chatbot není vždy ten nejspolehlivější a nejplynulejší odpověď nemusí být správná.

Pro každého, kdo používá AI v práci, je nejbezpečnější přístup jednoduchý. Považujte chatboty za akcelerátory, ne za konečné autority. Nechte je připravit návrhy, organizovat, shrnovat a generovat nápady. Pokud však odpověď ovlivňuje finance, zdraví, právo, identitu nebo rozhodnutí s reálnými důsledky, ověřte fakta před tím, než podniknete kroky.

Zanechte komentář